刚刚!OpenAI回滚了最新版本的GPT-4o,因ChatGPT「过于谄媚」

刚刚!OpenAI回滚了最新版本的GPT-4o,因ChatGPT「过于谄媚」昨晚,奥特曼在 X 上发了条帖子,大意是由于发现 GPT-4o 「过于谄媚」的问题,所以从周一晚上开始回滚 GPT-4o 的最新更新。

搜索

搜索

昨晚,奥特曼在 X 上发了条帖子,大意是由于发现 GPT-4o 「过于谄媚」的问题,所以从周一晚上开始回滚 GPT-4o 的最新更新。

坏了,AI 当「舔狗」这件事藏不住了。今天凌晨,OpenAI CEO Sam Altman 发了一个有趣帖子,大意是:由于最近几轮 GPT-4o 的更新,导致其个性变得过于阿谀奉承,因此官方决定尽快进行修复。

自 OpenAI 发布 chatgpt 以来,业内除了技术公司、媒体公司比较关注其进展以外,还有一个行业比较关注,那就是战略咨询行业。尤其是最近 GPT-4o、Claude 3.7 Sonnet 为代表的最新大模型在数据分析、内容生成、编码和复杂推理方面展现出强大能力,与战略咨询工作的核心环节高度相关 。

刚出道的 HiDream-I1,拿下了 Hugging Face 趋势榜第二(图像榜第一),Artificial Analysis 文生图第二,排在Midjourney、Google Imagen、FLUX、SDXL 之前,仅次于 GPT-4o 。

从 ChatGPT 引发认知革命到 GPT-4o 实现多模态跨越,AI 技术的每次跃迁都在印证一个底层逻辑 —— 数据质量决定智能高度。而今,这场 AI 浪潮正在反哺数据库领域,推动其从幕后走向台前,完成智能时代的华丽转身。

最近几天,OpenAI 革新的 GPT-4o 图像功能给大家带来了不少乐趣,各路社交媒体都被「吉卜力」风格的图像、视频刷了屏。机器之心还尝试了制作了《甄嬛传》的名场面(视频如下,制作方法参见《GPT-4o 整活!3 个小时、6 个镜头重现吉卜力版《甄嬛传》名场面》)。

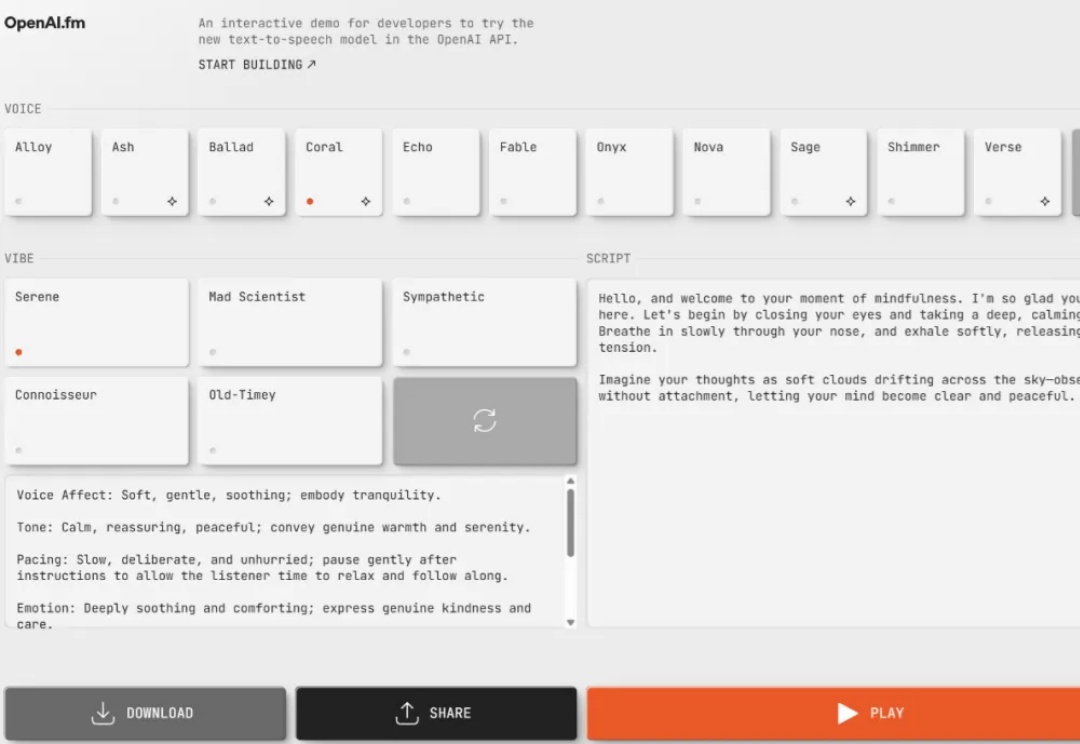

现在,你可以指导 GPT-4o 的说话方式了。

就在刚刚,OpenAI 宣布在其 API 中推出全新一代音频模型,包括语音转文本和文本转语音功能,让开发者能够轻松构建强大的语音 Agent。据 OpenAI 介绍,新推出的 gpt-4o-transcribe 采用多样化、高质量音频数据集进行了长时间的训练,能更好地捕获语音细微差别,减少误识别,大幅提升转录可靠性。

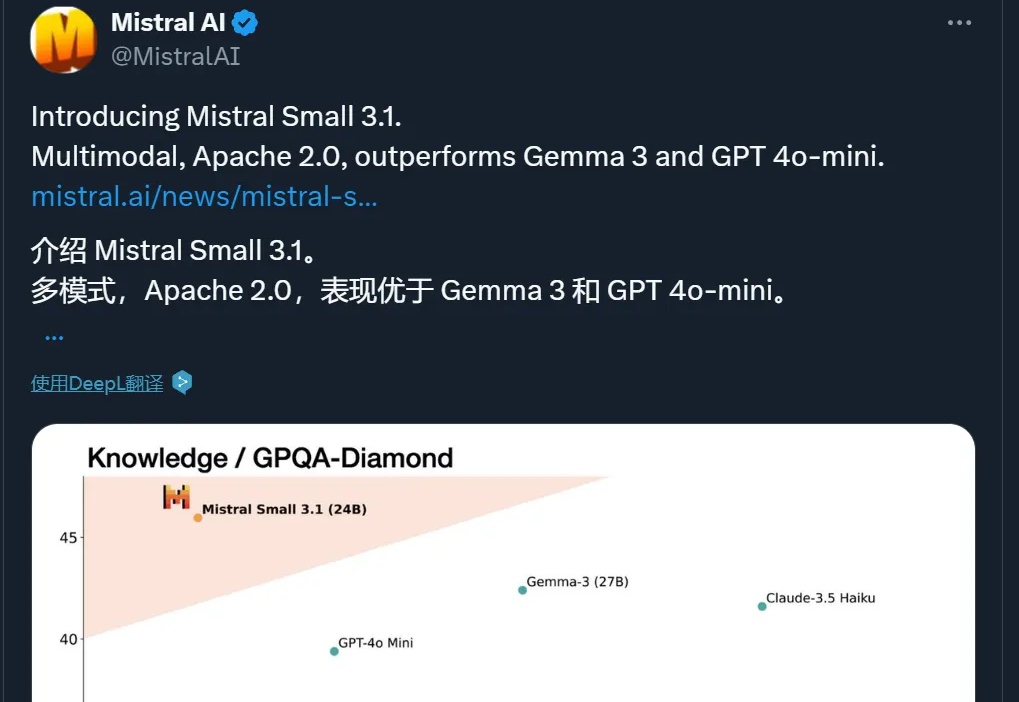

多模态,性能超 GPT-4o Mini、Gemma 3,还能在单个 RTX 4090 上运行,这个小模型值得一试。

要知道,过去几年,各种通用评测逐渐同质化,越来越难以评估模型真实能力。GPQA、MMLU-pro、MMLU等流行基准,各家模型出街时人手一份,但局限性也开始暴露,比如覆盖范围狭窄(通常不足 50 个学科),不含长尾知识;缺乏足够挑战性和区分度,比如 GPT-4o 在 MMLU-Pro 上准确率飙到 92.3%。